Mac miniを核とした自宅AIエージェント要塞:構築から安定運用までの完全ガイド

はじめに:なぜ今、自宅AIエージェント要塞なのか?

近年、AIエージェント技術は目覚ましく進化し、単一タスク実行に留まらず、複数のツール連携による複雑な目標の自律達成を可能にした。この進化を受け、自宅でのAIエージェント環境構築は大きな魅力となる。

自宅サーバー、いわゆるセルフホスティングには多くの利点がある。第一にデータ主権。機密性の高い情報や個人的データを含むAIエージェントを、外部サービスに依存せず管理下に置ける。第二にカスタマイズ性。特定のワークフローやニーズに合わせ、AIエージェントの構成を自由に調整し、独自の機能を組み込める。第三にコスト最適化。クラウドサービスの従量課金モデルと比較し、初期投資はかかるものの、長期的な運用コストを大幅に削減する可能性がある。

AppleのMac mini (Mシリーズ) は、自宅AIサーバーの核として適する。省電力性と高性能を両立し、既存のAppleエコシステムとの親和性も高い。

本ガイドでは、Mac miniを核としたセルフホスト型AIエージェント環境、特にOpenClawやAntigravityといった先進エージェントの安定運用に関する実践的ノウハウを提供する。ハードウェア選定、堅牢な基盤環境構築、複数エージェント連携、自宅ネットワークのセキュリティ確保、コスト効率化まで、筆者の経験に基づく情報を詳述する。

本ガイドは、自宅サーバー管理者、AI研究者、セルフホスティングに興味を持つエンジニア、およびMac miniユーザーが、自身のAIエージェント要塞を築く一助となることを目指す。

Mac mini (Mシリーズ) をUbuntuサーバーへ:基盤環境の構築

自宅AIエージェント要塞の第一歩は、Mac miniを堅牢なサーバー基盤へと変貌させることである。MシリーズMac miniはARM64アーキテクチャを採用しているため、従来のIntel Macとは異なる考慮事項があるが、Ubuntu Serverを導入することで、安定した開発・運用環境を構築できる。

Mac mini (Mシリーズ) へのUbuntu Serverのインストール手順とMシリーズ特有の考慮事項

MシリーズMac miniへのUbuntu Serverのインストールは、Asahi Linuxプロジェクトを利用して行う。同プロジェクトはMシリーズでのLinux利用を可能にするものであり、インストール手順は公式ドキュメントに詳述されている。主要な流れは以下の通りである。

- Asahi Linuxインストーラーのダウンロードと実行: macOS環境からインストーラーを起動し、ディスクパーティションを分割する。

- Ubuntu Serverの選択: インストーラーの指示に従い、

Ubuntu Server (minimal)などのエディションを選択する。 - Mシリーズ特有の注意点:

- ARM64アーキテクチャ: すべてのソフトウェアがARM64に対応しているか確認が必要である。Dockerイメージなども

arm64v8タグが付いているものを選ぶ必要がある。 - Wi-Fi/Bluetoothドライバ: 執筆時点では、一部のMシリーズMac miniでWi-FiやBluetoothのサポートが限定的である場合がある。安定性確保のため、有線LAN接続を推奨する。

- ARM64アーキテクチャ: すべてのソフトウェアがARM64に対応しているか確認が必要である。Dockerイメージなども

DockerおよびDocker Composeの導入と設定:AIエージェント実行環境の確立

AIエージェント群を効率的かつ独立して運用するには、DockerとDocker Composeの導入が必須である。

# Dockerのインストール

sudo apt update

sudo apt install ca-certificates curl gnupg

sudo install -m 0755 -d /etc/apt/keyrings

curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo gpg --dearmor -o /etc/apt/keyrings/docker.gpg

sudo chmod a+r /etc/apt/keyrings/docker.gpg

echo \

"deb [arch="$(dpkg --print-architecture)" signed-by=/etc/apt/keyrings/docker.gpg] https://download.docker.com/linux/ubuntu \

"$(. /etc/os-release && echo "$VERSION_CODENAME")" stable" | \

sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

sudo apt update

sudo apt install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

# 現在のユーザーをdockerグループに追加

sudo usermod -aG docker $USER

# 反映のため再ログインが必要

これにより、各AIエージェントは独立したコンテナとして動作し、依存関係の衝突を避けることができる。

システムリソース(メモリ、ストレージ、ネットワーク)の最適化と性能チューニング

Mac miniの限られたリソースを最大限に活用するため、以下の最適化を実施した。

- メモリ: スワップ領域の適正化(過剰なスワップはSSDの寿命を縮める)。可能であれば、AIエージェントの要件に合わせて物理メモリを多めに搭載したモデルを選ぶのが理想である。

- ストレージ: 高速なNVMe SSDを最大限に活かすため、ファイルシステムは

ext4を採用する。I/O性能がボトルネックにならないよう、ログの書き込み頻度などを調整する。データ保存には外部SSDを利用し、システム領域と分離することで復旧を容易にする。 - ネットワーク: 有線LAN接続を基本とし、IPv4/IPv6の適切な設定、DNSキャッシュ(

systemd-resolvedなど)の利用で、ネットワーク遅延を最小限に抑える。

SSHによるセキュアなリモートアクセス環境の構築と基本操作

自宅AIエージェント要塞を管理するには、SSHによるセキュアなリモートアクセスが不可欠である。

# OpenSSHサーバーのインストール

sudo apt install openssh-server

# SSH鍵の生成(クライアント側で実行)

ssh-keygen -t ed25519 -C "your_email@example.com"

# 公開鍵の転送(Mac mini側へ)

ssh-copy-id -i ~/.ssh/id_ed25519.pub user@your_macmini_ip

セキュリティ強化のため、パスワード認証を無効化し、公開鍵認証のみを利用する。また、SSHポートをデフォルトの22番から変更することも、基本的なセキュリティ対策として実践する。

# /etc/ssh/sshd_config の編集例

# Port 2222 # デフォルトの22番から変更

# PasswordAuthentication no

# PubkeyAuthentication yes

# PermitRootLogin no

sudo systemctl restart sshd

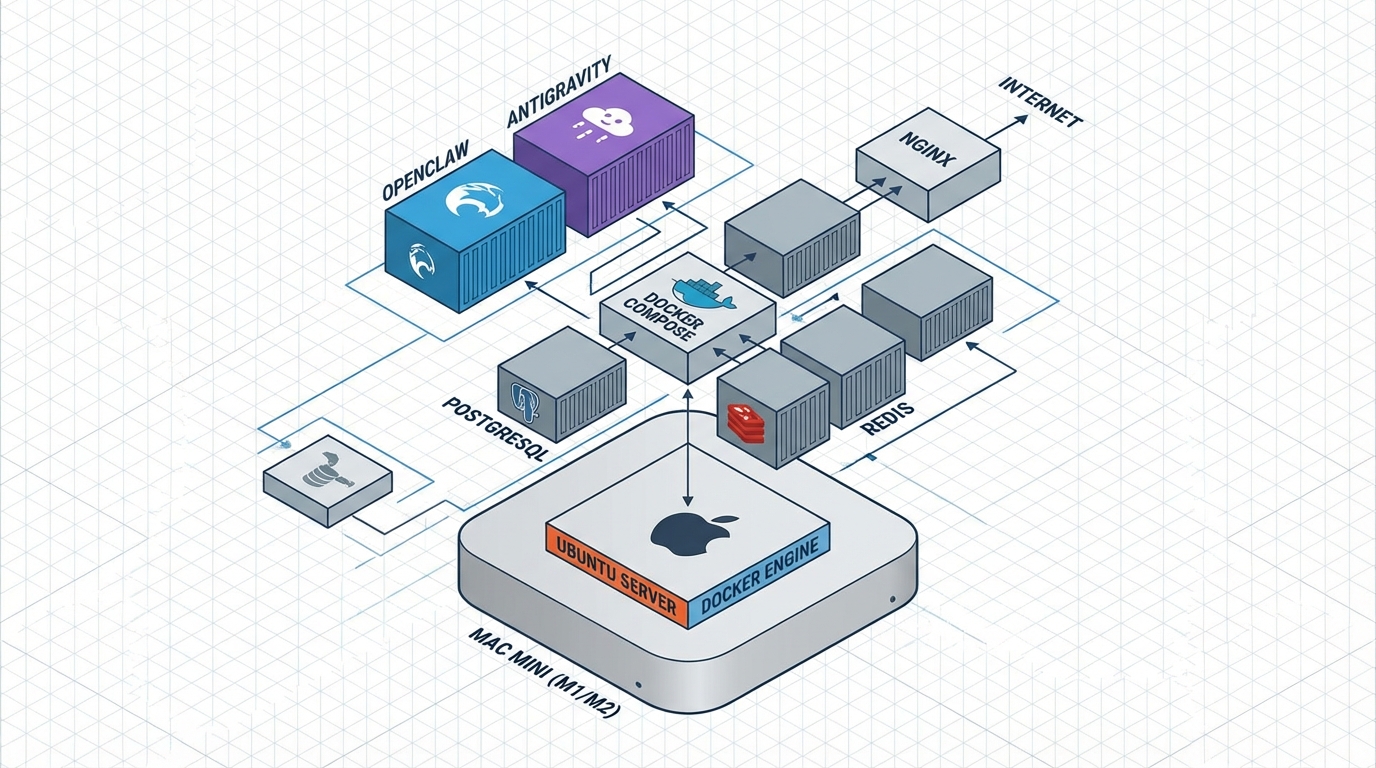

複数AIエージェントをDocker Composeで連携:要塞の核心部

AIエージェント要塞の真骨頂は、複数のAIエージェントが連携し、複雑なタスクを自律的にこなす点にある。これをDocker Composeを用いて実現する。

主要AIエージェント(OpenClaw, Antigravityなど)の概要と導入メリット

- OpenClaw: 高度なタスク計画と実行能力を持つAIエージェントフレームワークである。これを中心に据え、長期的な目標達成のためのブレインとして活用する。

- Antigravity: 特定のウェブスクレイピングやデータ収集タスクに特化したエージェントとして利用する。OpenClawと連携し、必要な情報をリアルタイムで取得する役割を担わせる。

- その他、コード生成AI(Code Llamaなど)や画像生成AI(Stable Diffusionなど)をローカルで稼働させ、必要に応じてエージェントが呼び出す構成を検討する。

Dockerコンテナ化の最大のメリットは、各エージェントがそれぞれ異なる依存関係を持っていても、互いに影響を与えることなく、独立した環境で動作させられる点である。

各AIエージェントのDockerイメージ取得とコンテナ化の準備

ほとんどの先進的なAIエージェントは、DockerイメージまたはDockerfileが提供されている。公式のDocker Hubからイメージをプルするか、必要に応じてDockerfileをカスタマイズして独自のイメージをビルドする。

# 例: 特定のAIエージェントのDockerイメージをプル

docker pull user/openclaw:latest

docker pull user/antigravity:latest

Docker Composeを用いたマルチエージェント環境の設計と実装

docker-compose.ymlファイルは、AIエージェント要塞の設計図である。このファイル一つで、複数のサービス(エージェント)、ネットワーク、ボリュームを一元的に定義し、起動・停止・管理が可能である。

以下は、仮想的なdocker-compose.ymlのサンプルである。

version: '3.8'

services:

openclaw:

image: user/openclaw:latest

container_name: openclaw_agent

environment:

- OPENCLAW_API_KEY=${GEMINI_API_KEY} # 環境変数でAPIキーを渡す

- OPENCLAW_LLM_MODEL=gemini-pro

volumes:

- ./data/openclaw:/app/data

ports:

- "8000:8000"

networks:

- ai_agents_net

restart: always

antigravity:

image: user/antigravity:latest

container_name: antigravity_scraper

environment:

- ANTIGRAVITY_API_ENDPOINT=http://openclaw:8000/api # OpenClawへの参照

volumes:

- ./data/antigravity:/app/data

networks:

- ai_agents_net

restart: always

# 他のAIエージェントやツール(例: ローカルLLM、データベースなど)を追加

# example_llm:

# image: local_llm_server:latest

# ports:

# - "8080:8080"

# networks:

# - ai_agents_net

# restart: always

networks:

ai_agents_net:

driver: bridge

この設定では、openclawとantigravityの2つのサービスが定義され、それぞれがai_agents_netという共通のネットワーク内で通信できる。volumesを使ってホストマシンとデータを永続化し、portsで外部からのアクセスを可能にしている。

エージェント間連携とサービスディスカバリ、ネットワーク設定

Docker Composeのカスタムネットワーク(ここではai_agents_net)を使うことで、各コンテナはサービス名(例: openclaw、antigravity)を使って互いにアクセスできる。これにより、複雑なIPアドレス設定なしに、エージェント間でAPIを呼び出したり、メッセージを交換したりすることが可能になる。

例えば、antigravityエージェントはhttp://openclaw:8000/apiというURLでopenclawエージェントのAPIエンドポイントにアクセス可能である。これはDockerの組み込みDNS機能によるサービスディスカバリが実現する。この仕組みを利用し、エージェントが連携してタスクを分担するマイクロサービスアーキテクチャを構築する。

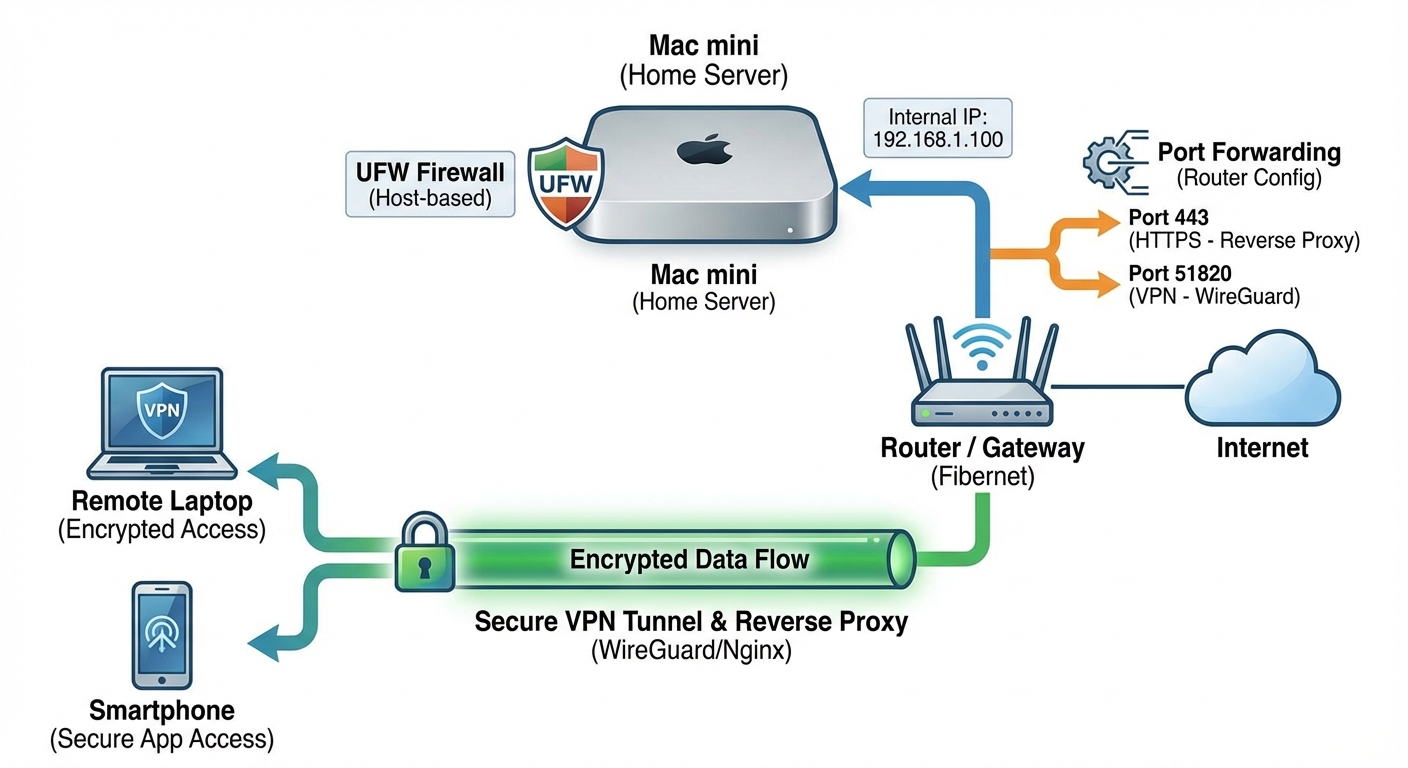

自宅ネットワークにおける要塞の防御と公開

AIエージェント要塞を自宅に構える上で、ネットワークセキュリティは最も重要な要素の一つである。外部からの不正アクセスを防ぎつつ、必要な時に安全にアクセスできるようにする戦略を練る。

ポートフォワーディングの基本とルーター設定を通じた外部からのアクセス制御

AIエージェントのWebインターフェースやAPIを外部から利用したい場合、ルーターのポートフォワーディング設定が必要となる。例えば、OpenClawのWeb UIがMac miniの8000番ポートで動作している場合、ルーターの特定ポート(例: 443番や任意のカスタムポート)をMac miniの8000番ポートに転送する。

ただし、不必要なポートフォワーディングは極力避けるべきである。外部に公開するサービスは最小限に留め、可能であれば次のセキュアなリモートアクセス戦略を優先する。

セキュアなリモートアクセス戦略:VPN、SSHトンネル、リバースプロキシ(Nginx/Caddy)の導入検討

より安全なリモートアクセス方法は以下の通りである。

- VPN (Virtual Private Network): 自宅ルーターのVPNサーバー機能、またはRaspberry PiなどでのOpenVPN/WireGuardサーバー構築により、VPNクライアントから接続し、自宅ネットワーク内部にいるかのようにMac miniにアクセスする。これは最も安全かつ柔軟な方法である。

- SSHトンネル: 特定のポートのみを安全に転送したい場合に有効である。例えば、ローカルマシンの8000番ポートをMac miniの8000番ポートにトンネリングすることで、Mac miniのWeb UIに安全にアクセスできる。

bash

ssh -L 8000:localhost:8000 user@your_macmini_ip

- リバースプロキシ (Nginx/Caddy): Webサービスを外部に公開する必要がある場合、NginxやCaddyをリバースプロキシとして利用し、SSL/TLS (HTTPS) で暗号化する。これにより、トラフィックは安全に保護され、単一のエンドポイントで複数のサービスを管理できるようになる。また、Let’s Encryptを利用すれば無料でSSL証明書を取得できる。

ファイアウォール(UFW)によるアクセス制限とセキュリティグループ設定

Ubuntu ServerにはUFW (Uncomplicated Firewall) が標準搭載されており、Mac miniへのアクセス制御に利用できる。

# UFWの有効化

sudo ufw enable

# SSHポートの許可(変更後のポート番号を使用)

sudo ufw allow 2222/tcp

# 特定のIPアドレスからのSSHアクセスのみ許可(例: 自宅オフィスの固定IP)

sudo ufw allow from 192.0.2.0/24 to any port 2222

# Dockerコンテナのポート許可(必要な場合のみ)

# DockerはUFWルールを迂回する場合があります。詳細な設定はDockerのドキュメントを参照。

sudo ufw allow 8000/tcp # OpenClawのWeb UIなど

# デフォルトで全て拒否

sudo ufw default deny incoming

sudo ufw default allow outgoing

# ステータスの確認

sudo ufw status verbose

ネットワークセキュリティのベストプラクティス:強固な認証、定期的なセキュリティパッチ適用

- 強固な認証: SSH公開鍵認証を必須とし、パスワード認証を無効化する。すべてのユーザーアカウントで強力なパスワードを設定する。

- 定期的なセキュリティパッチ適用: OS、Docker、各AIエージェントのソフトウェアは常に最新の状態に保つ。

unattended-upgradesを設定し、セキュリティアップデートを自動適用する。 - 不要なサービスの停止: Mac mini上で動作させる必要のないサービスは停止し、アタックサーフェスを最小限に抑える。

Gemini APIキーの安全な管理とコスト効率化

多くのAIエージェントは、Google Geminiのような外部LLM(大規模言語モデル)のAPIを利用してその能力を最大限に発揮する。このGemini APIキーの安全な管理と、利用コストの効率化は、自宅AIエージェント要塞を運用する上で避けては通れない課題である。

APIキーの安全な管理方法:環境変数、Docker Secrets、HashiCorp Vault等の利用

APIキーは、システムへのアクセス権を与える極めて重要な情報である。以下の方法で安全に管理する。

- 環境変数: 最も基本的な方法であり、

docker-compose.ymlで定義したように、environmentセクションでAPIキーを渡す。ただし、docker inspectなどでキーが漏洩するリスクがあるため、本番環境では注意が必要である。

“`yaml

environment:- GEMINIAPIKEY=${GEMINIAPIKEY} # ホストの環境変数から取得

“`

- GEMINIAPIKEY=${GEMINIAPIKEY} # ホストの環境変数から取得

- Docker Secrets: Docker Swarmモードで利用できる機能であるが、単一ホストのDockerでも実験的に利用可能である。キーをファイルとしてコンテナ内にマウントし、環境変数よりもセキュアに扱える。重要なキーにはこの方法を検討すべきである。

- HashiCorp Vault: より高度なセキュリティ要件がある場合、Vaultのような秘密情報管理ツールの導入を検討する。これにより、APIキーだけでなく、データベースの認証情報なども一元的に、かつ監査可能な形で管理できる。自宅サーバーでは過剰な場合もあるが、将来的な拡張性を考慮すれば選択肢となる。

APIキーを直接コードに埋め込んだり、バージョン管理システムにコミットしたりすることは厳に避けるべきである。

Gemini APIのレート制限(Rate Limiting)の理解と対策(指数関数的バックオフ、キャッシング戦略)

Gemini APIには利用頻度に対するレート制限が存在し、無視するとエラーやエージェントの動作停止を招く。以下の対策を講じる。

- 指数関数的バックオフ: APIリクエストがレート制限で失敗した場合、すぐに再試行せず、徐々に待機時間を延ばしながら再試行するロジックをエージェントに組み込む。

- キャッシング戦略: 頻繁に問い合わせるが結果が変化しにくいデータ(例: 事前定義されたプロンプトテンプレート、過去の応答の一部)は、ローカルのRedisやファイルシステムにキャッシュする。これにより、API呼び出し回数を削減し、応答速度も向上させる。

API利用状況のモニタリングツールと予算アラートの設定

コスト管理のため、Gemini APIの利用状況を定期的にモニタリングする。

- Google Cloud Platform (GCP) の課金アラート: GCPの課金設定で、特定の閾値を超えた場合にメール通知が来るように設定する。これにより、予期せぬAPI利用による高額請求を防ぐ。

- ローカルでのログ解析: 各エージェントがAPIを呼び出した回数をログに記録し、定期的に集計して分析する。PrometheusとGrafanaを導入し、API呼び出し回数やエラー率をダッシュボードで可視化することを計画する。

コスト最適化のためのAPI利用戦略:モデル選択、プロンプトエンジニアリング、オンプレミスLLMとの併用

コスト効率を最大化するため、以下の戦略を採用する。

- モデル選択: Gemini APIには複数のモデル(例: Gemini Pro, Gemini Ultra)が存在し、それぞれ性能とコストが異なる。タスクの複雑性に応じて適切なモデルを選択し、不必要に高性能なモデルを使わないようにする。簡単なタスクであれば、より安価なモデルを利用する。

- プロンプトエンジニアリング: プロンプトを簡潔にし、必要な情報だけを抽出するように工夫することで、トークン数を削減する。これはコスト削減だけでなく、応答速度の向上にも寄与する。

- オンプレミスLLMとの併用: 特定のタスク(例: 長文の要約、簡単な質問応答)では、Mac mini上で動く小規模なオンプレミスLLM (例えば、Ollamaで動かすLlama 2の小型版など) を利用する。これにより、Gemini APIの利用を真に高度な推論や創造性が必要なタスクに限定し、全体のコストを大幅に削減できると考える。

AIエージェント要塞の安定稼働とトラブルシューティング事例

要塞を築くだけでなく、その安定稼働を維持し、万が一のトラブルにも迅速に対応できる体制を整えることが重要である。

システムおよびコンテナのロギングとモニタリング(Docker logs, Prometheus/Grafana連携)

システム全体の健全性を把握するため、ロギングとモニタリングは重要である。

- Docker logs: 各コンテナのログは

docker logs <container_name>で確認できる。これを定期的にチェックし、エラーや警告がないか監視する。 - ログ管理システム:

ELK Stack(Elasticsearch, Logstash, Kibana) やLoki + Grafanaを導入し、集約されたログを検索・分析できる環境を構築することを計画する。これにより、問題発生時の原因究明が格段に早くなる。 - Prometheus/Grafana連携: Mac miniのシステムリソース(CPU使用率、メモリ、ディスクI/O、ネットワークトラフィック)とDockerコンテナのメトリクス(CPU、メモリ、再起動回数など)をPrometheusで収集し、Grafanaのダッシュボードでリアルタイムに可視化する。これにより、リソースの枯渇や予期せぬ動作を早期に発見できる。

定期的なメンテナンスとアップデート戦略:OS、Docker、AIエージェントの各コンポーネント

システムを安全かつ高性能に保つため、定期的なメンテナンスとアップデートが不可欠である。

- OSアップデート:

sudo apt update && sudo apt upgradeを定期的に実行し、セキュリティパッチやバグ修正を適用する。前述のunattended-upgradesも活用する。 - Dockerアップデート: Dockerエンジンのアップデートは、新しい機能やセキュリティ修正が含まれるため、慎重に計画して実行する。

- AIエージェントのアップデート: 各AIエージェントのDockerイメージや設定ファイルは、開発元から提供される最新バージョンに追従する。特に、脆弱性修正が含まれる場合は迅速に対応する。テスト環境で先にアップデートを適用し、問題がないことを確認してから本番環境に適用するようにする。

設定ファイルとデータのバックアップ戦略と災害復旧計画

予期せぬデータ損失から要塞を守るため、堅牢なバックアップ戦略を確立する。

- 設定ファイルのバックアップ:

docker-compose.yml、Nginxの設定ファイル、UFWのルールなど、すべての設定ファイルをGitリポジトリで管理し、リモートのプライベートリポジトリにプッシュする。 - データのバックアップ: Dockerボリュームに保存されたAIエージェントのデータ(学習モデル、キャッシュ、実行履歴など)は、外部HDDやNAS、あるいはクラウドストレージ(例: rsyncとSSHを利用したS3へのバックアップ)に定期的に増分バックアップを取る。毎日夜間に

rsyncスクリプトをcronで実行し、自動的にバックアップを取る。 - 災害復旧計画: 最悪の場合、Mac miniが完全に故障しても、バックアップデータと設定ファイルがあれば、新しいMac miniや別のサーバーに環境を迅速に復旧できるよう、手順書を作成する。

一般的なトラブルシューティング:コンテナ起動失敗、ネットワーク問題、APIエラー、リソース枯渇

一般的なトラブルとその対処法をいくつか紹介する。

- コンテナ起動失敗:

docker logs <container_name>でエラーログを確認。docker-compose.ymlの設定ミスがないか確認(インデント、パスなど)。- ポート競合がないか確認(

netstat -tulnp)。 - DockerイメージがARM64に対応しているか確認。

- ネットワーク問題:

- Mac mini自体がネットワークに接続できているか(

ping google.com)。 - Dockerネットワーク内でコンテナ間通信ができているか(

docker exec <container_name> ping <another_container_name>)。 - ファイアウォールやルーター設定が適切か確認。

- Mac mini自体がネットワークに接続できているか(

- APIエラー:

- APIキーが正しいか、有効期限が切れていないか確認。

- レート制限に引っかかっていないか、

docker logsやAPIプロバイダーのダッシュボードで確認。 - APIエンドポイントが正しいか、ネットワーク経由で到達可能か確認。

- リソース枯渇:

htopやdocker statsでCPU、メモリ使用率を確認。df -hでディスク容量を確認。- 特定のAIエージェントが過剰にリソースを消費していないか特定し、設定を調整するか、あるいはより少ないリソースで動作するモデルに切り替えることを検討する。

まとめ:あなただけのAIエージェント要塞を築き上げよう

本ガイドでは、Mac miniを核とした自宅AIエージェント要塞の構築と安定運用に関する実践的ノウハウを提供した。

MシリーズMac miniへのUbuntu Server導入から、DockerとDocker Composeによる堅牢な基盤構築、OpenClawやAntigravityといったAIエージェントの連携、セキュアなネットワーク環境での運用防御策、APIキーの安全な管理とコスト最適化に焦点を当てた。また、要塞維持のためのモニタリング、メンテナンス、バックアップ戦略、トラブルシューティングのヒントも共有した。

本ガイドで得られる主要な知見は、技術的な設定に留まらず、セルフホスティングがもたらす「自由」と「責任」のバランスにある。データ主権、カスタマイズ性、コスト最適化という利点を享受する一方で、セキュリティ、安定稼働、メンテナンスの責任も伴う。このプロセスは、エンジニアとしてのスキルを磨き、技術理解を深める絶好の機会となる。

今後の展望:新たなAIエージェントの統合、MシリーズMac miniの更なる活用、分散型AIの可能性

自宅AIエージェント要塞はまだ完成形ではない。今後の展望として、以下の取り組みを検討する。

- 新たなAIエージェントの統合: 最新のオープンソースAIエージェントや、独自のカスタムエージェントを積極的に要塞に組み込み、その能力を拡張していく予定である。

- MシリーズMac miniの更なる活用: Mac miniのGPU性能を最大限に引き出すため、MLOpsツールやローカルでの大規模言語モデルの微調整(ファインチューニング)などにも挑戦する。

- 分散型AIの可能性: 複数のMac miniや他の低消費電力デバイスを連携させ、より大規模な分散型AIエージェントシステムを構築する可能性を探る。

エンジニアコミュニティにおける情報共有と協力の重要性

このような先進的な取り組みには、単独での限界が存在する。本ガイドが、自宅AIエージェント要塞の構築に挑戦する人々の出発点となり、コミュニティでの情報共有や協力のきっかけとなることを期待する。

個々の知見が結集することで、より強固で、より賢く、より安全なAIエージェント要塞が構築される。Mac miniを活用し、独自のAIエージェント要塞を築き、未来を拓く一歩を踏み出すことを推奨する。

コメント